Las redes neuronales son modelos computacionales que imitan las funciones complejas del cerebro humano. Las redes neuronales constan de nodos o neuronas interconectados que procesan y aprenden de datos, permitiendo tareas como el reconocimiento de patrones y la toma de decisiones en el aprendizaje automático. El artículo explora más sobre las redes neuronales, su funcionamiento, arquitectura y más.

Tabla de contenidos

- Evolución de las redes neuronales

- ¿Qué son las redes neuronales?

- ¿Cómo funcionan las redes neuronales?

- Aprendizaje de una red neuronal

- Tipos de redes neuronales

- Implementación simple de una red neuronal

Evolución de las redes neuronales

Desde la década de 1940, ha habido una serie de avances notables en el campo de las redes neuronales:

- Décadas de 1940 y 1950: primeros conceptos

Las redes neuronales comenzaron con la introducción del primer modelo matemático de neuronas artificiales por parte de McCulloch y Pitts. Pero las limitaciones computacionales dificultaron el progreso.

- Décadas de 1960 y 1970: perceptrones

Esta era está definida por el trabajo de Rosenblatt sobre los perceptrones. perceptrones Son redes de una sola capa cuya aplicabilidad se limitaba a problemas que podían resolverse linealmente por separado.

- Década de 1980: retropropagación y conexionismo

Red multicapa El entrenamiento fue posible gracias a la invención del método de retropropagación por parte de Rumelhart, Hinton y Williams. Con su énfasis en el aprendizaje a través de nodos interconectados, el conexionismo ganó atractivo.

- Década de 1990: auge e invierno

Con aplicaciones en identificación de imágenes, finanzas y otros campos, las redes neuronales experimentaron un auge. Sin embargo, la investigación de redes neuronales experimentó un invierno debido a costos computacionales exorbitantes y expectativas infladas.

- Década de 2000: resurgimiento y aprendizaje profundo

Conjuntos de datos más grandes, estructuras innovadoras y una capacidad de procesamiento mejorada impulsaron un regreso. Aprendizaje profundo ha demostrado una eficacia asombrosa en varias disciplinas mediante la utilización de numerosas capas.

- Década de 2010 al presente: dominio del aprendizaje profundo

Las redes neuronales convolucionales (CNN) y las redes neuronales recurrentes (RNN), dos arquitecturas de aprendizaje profundo, dominaron el aprendizaje automático. Su poder quedó demostrado por las innovaciones en juegos, reconocimiento de imágenes y procesamiento del lenguaje natural.

¿Qué son las redes neuronales?

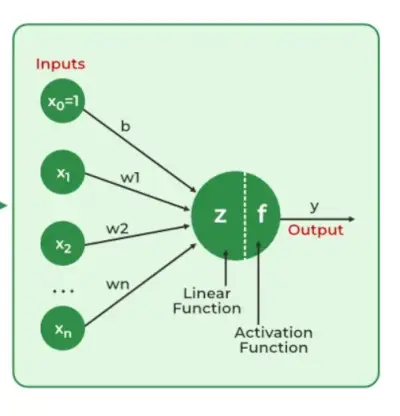

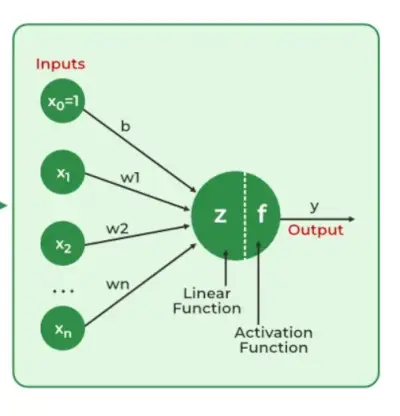

Redes neuronales extraer características de identificación de los datos, que carecen de comprensión preprogramada. Los componentes de la red incluyen neuronas, conexiones, pesos, sesgos, funciones de propagación y una regla de aprendizaje. Las neuronas reciben entradas, regidas por umbrales y funciones de activación. Las conexiones implican pesos y sesgos que regulan la transferencia de información. El aprendizaje, el ajuste de ponderaciones y sesgos, ocurre en tres etapas: cálculo de entrada, generación de salida y refinamiento iterativo que mejora la competencia de la red en diversas tareas.

convertir una cadena a un número entero

Éstas incluyen:

- La red neuronal se simula mediante un nuevo entorno.

- Luego, como resultado de esta simulación, se modifican los parámetros libres de la red neuronal.

- La red neuronal responde entonces de una manera nueva al entorno debido a los cambios en sus parámetros libres.

Importancia de las redes neuronales

La capacidad de las redes neuronales para identificar patrones, resolver acertijos complejos y adaptarse a entornos cambiantes es esencial. Su capacidad para aprender de los datos tiene efectos de largo alcance, que van desde revolucionar tecnologías como procesamiento natural del lenguaje y automóviles autónomos hasta automatizar los procesos de toma de decisiones y aumentar la eficiencia en numerosas industrias. El desarrollo de la inteligencia artificial depende en gran medida de las redes neuronales, que también impulsan la innovación e influyen en la dirección de la tecnología.

¿Cómo funcionan las redes neuronales?

Entendamos con un ejemplo cómo funciona una red neuronal:

Considere una red neuronal para la clasificación de correos electrónicos. La capa de entrada toma características como contenido del correo electrónico, información del remitente y asunto. Estas entradas, multiplicadas por pesos ajustados, pasan a través de capas ocultas. La red, mediante formación, aprende a reconocer patrones que indican si un correo electrónico es spam o no. La capa de salida, con una función de activación binaria, predice si el correo electrónico es spam (1) o no (0). A medida que la red refina iterativamente sus pesos a través de la retropropagación, se vuelve experta en distinguir entre spam y correos electrónicos legítimos, mostrando la practicidad de las redes neuronales en aplicaciones del mundo real como el filtrado de correo electrónico.

java agitando a int

Funcionamiento de una red neuronal

Las redes neuronales son sistemas complejos que imitan algunas características del funcionamiento del cerebro humano. Está compuesta por una capa de entrada, una o más capas ocultas y una capa de salida formada por capas de neuronas artificiales que se encuentran acopladas. Las dos etapas del proceso básico se denominan retropropagación y propagación hacia adelante .

Propagación directa

- Capa de entrada: Cada característica en la capa de entrada está representada por un nodo en la red, que recibe datos de entrada.

- Pesos y Conexiones: El peso de cada conexión neuronal indica qué tan fuerte es la conexión. A lo largo del entrenamiento, estos pesos se van cambiando.

- Capas ocultas: Cada neurona de capa oculta procesa entradas multiplicándolas por pesos, sumándolas y luego pasándolas por una función de activación. Al hacer esto, se introduce la no linealidad, lo que permite a la red reconocer patrones intrincados.

- Producción: El resultado final se produce repitiendo el proceso hasta llegar a la capa de salida.

Propagación hacia atrás

- Cálculo de pérdidas: La salida de la red se evalúa frente a los valores objetivo reales y se utiliza una función de pérdida para calcular la diferencia. Para un problema de regresión, la Error medio cuadrado (MSE) se utiliza comúnmente como función de costo.

Función de pérdida:

- Descenso de gradiente: Luego, la red utiliza el descenso de gradiente para reducir la pérdida. Para reducir la inexactitud, los pesos se cambian en función de la derivada de la pérdida con respecto a cada peso.

- Ajuste de pesos: Los pesos se ajustan en cada conexión aplicando este proceso iterativo, o propagación hacia atrás , hacia atrás a través de la red.

- Capacitación: Durante el entrenamiento con diferentes muestras de datos, todo el proceso de propagación hacia adelante, cálculo de pérdidas y propagación hacia atrás se realiza de forma iterativa, lo que permite que la red se adapte y aprenda patrones a partir de los datos.

- Funciones de activación: La no linealidad del modelo se introduce mediante funciones de activación como la unidad lineal rectificada (ReLU) horas sigmoideo . Su decisión sobre si activar una neurona se basa en toda la entrada ponderada.

Aprendizaje de una red neuronal

1. Aprendizaje con aprendizaje supervisado

En aprendizaje supervisado , la red neuronal está guiada por un profesor que tiene acceso a ambos pares de entrada-salida. La red crea salidas basadas en entradas sin tener en cuenta el entorno. Al comparar estas salidas con las salidas deseadas conocidas por el profesor, se genera una señal de error. Para reducir errores, los parámetros de la red se cambian de forma iterativa y se detienen cuando el rendimiento alcanza un nivel aceptable.

java len de matriz

2. Aprendizaje con aprendizaje no supervisado

Las variables de producción equivalentes están ausentes en aprendizaje sin supervisión . Su objetivo principal es comprender la estructura subyacente (X) de los datos entrantes. No hay ningún instructor presente para ofrecer consejos. En cambio, el resultado previsto es modelar patrones y relaciones de datos. Palabras como regresión y clasificación están relacionadas con el aprendizaje supervisado, mientras que el aprendizaje no supervisado está asociado con la agrupación y la asociación.

3. Aprendizaje con aprendizaje por refuerzo

A través de la interacción con el entorno y la retroalimentación en forma de recompensas o penalizaciones, la red adquiere conocimiento. Encontrar una política o estrategia que optimice las recompensas acumulativas a lo largo del tiempo es el objetivo de la red. Este tipo se utiliza con frecuencia en aplicaciones de juegos y toma de decisiones.

Tipos de redes neuronales

Hay Siete Tipos de redes neuronales que se pueden utilizar.

- Redes de avance: A red neuronal de avance es una arquitectura de red neuronal artificial simple en la que los datos se mueven de la entrada a la salida en una sola dirección. Tiene capas de entrada, oculta y de salida; Los circuitos de retroalimentación están ausentes. Su arquitectura sencilla lo hace apropiado para una serie de aplicaciones, como la regresión y el reconocimiento de patrones.

- Perceptrón multicapa (MLP): MLP Es un tipo de red neuronal feedforward con tres o más capas, incluida una capa de entrada, una o más capas ocultas y una capa de salida. Utiliza funciones de activación no lineales.

- Red neuronal convolucional (CNN): A Red neuronal convolucional (CNN) es una red neuronal artificial especializada diseñada para el procesamiento de imágenes. Emplea capas convolucionales para aprender automáticamente características jerárquicas a partir de imágenes de entrada, lo que permite un reconocimiento y clasificación de imágenes efectivos. Las CNN han revolucionado la visión por computadora y son fundamentales en tareas como la detección de objetos y el análisis de imágenes.

- Red neuronal recurrente (RNN): Un tipo de red neuronal artificial destinada al procesamiento secuencial de datos se denomina Red neuronal recurrente (RNN). Es apropiado para aplicaciones donde las dependencias contextuales son críticas, como la predicción de series temporales y el procesamiento del lenguaje natural, ya que utiliza bucles de retroalimentación que permiten que la información sobreviva dentro de la red.

- Memoria larga a corto plazo (LSTM): LSTM es un tipo de RNN que está diseñado para superar el problema del gradiente de desaparición en el entrenamiento de RNN. Utiliza celdas y puertas de memoria para leer, escribir y borrar información de forma selectiva.

Implementación simple de una red neuronal

Python3

import> numpy as np> # array of any amount of numbers. n = m> X>=> np.array([[>1>,>2>,>3>],> >[>3>,>4>,>1>],> >[>2>,>5>,>3>]])> # multiplication> y>=> np.array([[.>5>, .>3>, .>2>]])> # transpose of y> y>=> y.T> # sigma value> sigm>=> 2> # find the delta> delt>=> np.random.random((>3>,>3>))>-> 1> for> j>in> range>(>100>):> > ># find matrix 1. 100 layers.> >m1>=> (y>-> (>1>/>(>1> +> np.exp(>->(np.dot((>1>/>(>1> +> np.exp(> >->(np.dot(X, sigm))))), delt))))))>*>((>1>/>(> >1> +> np.exp(>->(np.dot((>1>/>(>1> +> np.exp(> >->(np.dot(X, sigm))))), delt)))))>*>(>1>->(>1>/>(> >1> +> np.exp(>->(np.dot((>1>/>(>1> +> np.exp(> >->(np.dot(X, sigm))))), delt)))))))> ># find matrix 2> >m2>=> m1.dot(delt.T)>*> ((>1>/>(>1> +> np.exp(>->(np.dot(X, sigm)))))> >*> (>1>->(>1>/>(>1> +> np.exp(>->(np.dot(X, sigm)))))))> ># find delta> >delt>=> delt>+> (>1>/>(>1> +> np.exp(>->(np.dot(X, sigm))))).T.dot(m1)> ># find sigma> >sigm>=> sigm>+> (X.T.dot(m2))> # print output from the matrix> print>(>1>/>(>1> +> np.exp(>->(np.dot(X, sigm)))))> |

>

>

Producción:

[[0.99999325 0.99999375 0.99999352] [0.99999988 0.99999989 0.99999988] [1. 1. 1. ]]>

Ventajas de las redes neuronales

Las redes neuronales se utilizan ampliamente en muchas aplicaciones diferentes debido a sus numerosos beneficios:

- Adaptabilidad: Las redes neuronales son útiles para actividades donde el vínculo entre entradas y salidas es complejo o no está bien definido porque pueden adaptarse a nuevas situaciones y aprender de los datos.

- Reconocimiento de patrones: Su competencia en el reconocimiento de patrones los hace eficaces en tareas como la identificación de audio e imágenes, el procesamiento del lenguaje natural y otros patrones de datos complejos.

- Procesamiento en paralelo: Debido a que las redes neuronales son capaces de realizar procesamiento paralelo por naturaleza, pueden procesar numerosos trabajos a la vez, lo que acelera y mejora la eficiencia de los cálculos.

- No linealidad: Las redes neuronales son capaces de modelar y comprender relaciones complicadas en los datos gracias a las funciones de activación no lineales que se encuentran en las neuronas, que superan los inconvenientes de los modelos lineales.

Desventajas de las redes neuronales

Las redes neuronales, aunque poderosas, no están exentas de inconvenientes y dificultades:

- Intensidad computacional: El entrenamiento de redes neuronales grandes puede ser un proceso laborioso y exigente desde el punto de vista computacional que exige mucha potencia informática.

- Caja negra Naturaleza: Como modelos de caja negra, las redes neuronales plantean un problema en aplicaciones importantes, ya que es difícil entender cómo toman decisiones.

- Sobreajuste: El sobreajuste es un fenómeno en el que las redes neuronales memorizan material de entrenamiento en lugar de identificar patrones en los datos. Aunque los enfoques de regularización ayudan a aliviar esto, el problema aún existe.

- Necesidad de grandes conjuntos de datos: Para un entrenamiento eficiente, las redes neuronales frecuentemente necesitan conjuntos de datos etiquetados y de tamaño considerable; de lo contrario, su desempeño puede verse afectado por datos incompletos o sesgados.

Preguntas frecuentes (FAQ)

1. ¿Qué es una red neuronal?

Una red neuronal es un sistema artificial formado por nodos (neuronas) interconectados que procesan información, siguiendo el modelo de la estructura del cerebro humano. Se emplea en trabajos de aprendizaje automático donde se extraen patrones de datos.

pitón camelcase

2. ¿Cómo funciona una red neuronal?

Capas de neuronas conectadas procesan datos en redes neuronales. La red procesa datos de entrada, modifica pesos durante el entrenamiento y produce una salida dependiendo de los patrones que ha descubierto.

3. ¿Cuáles son los tipos comunes de arquitecturas de redes neuronales?

Las redes neuronales de avance, las redes neuronales recurrentes (RNN), las redes neuronales convolucionales (CNN) y las redes de memoria a corto plazo (LSTM) son ejemplos de arquitecturas comunes, cada una de las cuales está diseñada para una determinada tarea.

4. ¿Cuál es la diferencia entre el aprendizaje supervisado y no supervisado en redes neuronales?

En el aprendizaje supervisado, los datos etiquetados se utilizan para entrenar una red neuronal para que pueda aprender a asignar entradas a salidas coincidentes. El aprendizaje no supervisado funciona con datos sin etiquetar y busca estructuras o patrones en los datos. .

5. ¿Cómo manejan las redes neuronales los datos secuenciales?

Los bucles de retroalimentación que incorporan las redes neuronales recurrentes (RNN) les permiten procesar datos secuenciales y, con el tiempo, capturar dependencias y contexto.